tg-me.com/ds_interview_lib/808

Last Update:

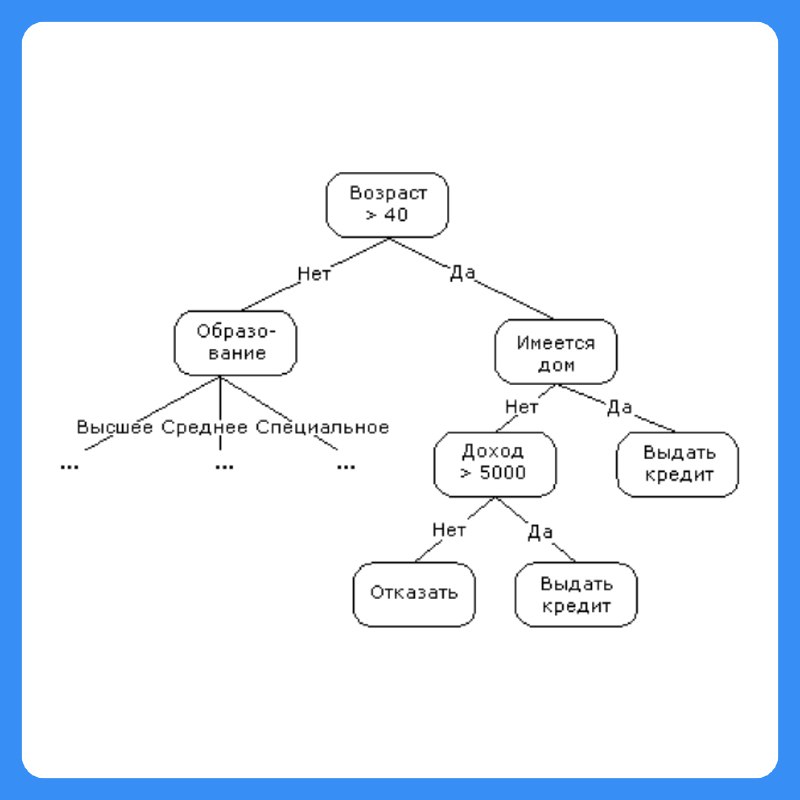

👀 Какие три наиболее часто используемые меры для оптимального разбиения атрибутов в дереве решений

1. Энтропия: позволяет измерить степень неопределённости или «разнородности» данных.

2. Индекс Джини (Gini impurity): оценивает вероятность того, что случайно выбранный элемент будет классифицирован неправильно.

3. Ошибка классификации: простая метрика, показывающая долю неверных классификаций в узле.

Какой метод выбрать

✅ Энтропия и индекс Gini чаще используются, так как они чувствительнее к изменениям в распределении данных.

✅ Ошибка классификации проще, но менее информативна для построения дерева решений.

BY Библиотека собеса по Data Science | вопросы с собеседований

Share with your friend now:

tg-me.com/ds_interview_lib/808